Inductive Biases for Deep Learning of Higher-Level Cognition

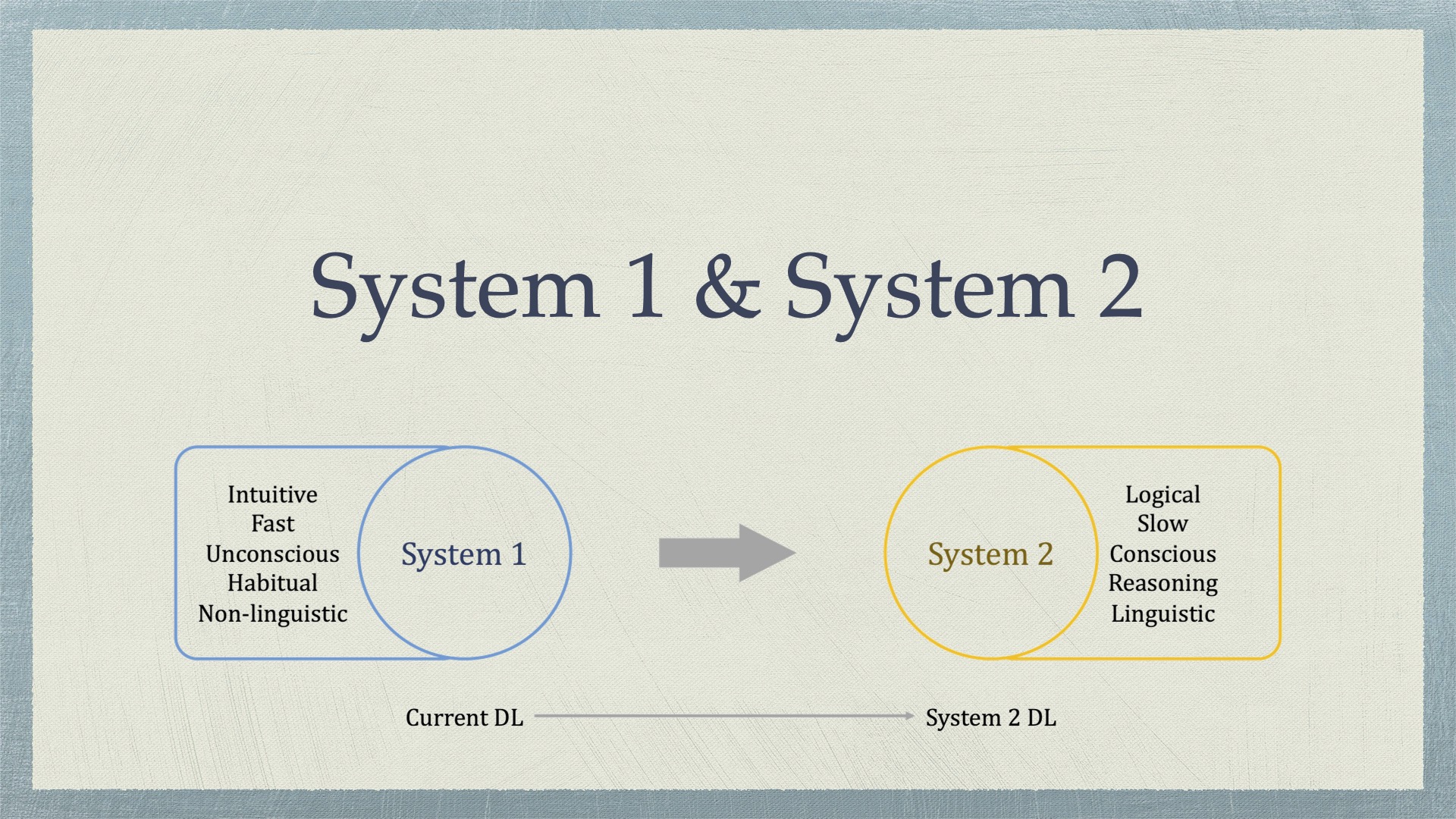

论文 link:https://arxiv.org/abs/2011.15091 相关演讲:Yoshua Bengio: From System 1 to System 2 Deep Learning (NeurIPS 2019) 首先放上一个我做的论文报告的 slide 吧: 现在正文开始! 注:本文是笔记而非原论文的翻译(但几乎也快是了),掺杂了个人叙述,如有不妥欢迎讨论。 1 深度

![[xv6-mit-6.S081-2020]Lab10: mmap](/blog-main/gallery/cover/xv6.jpg)